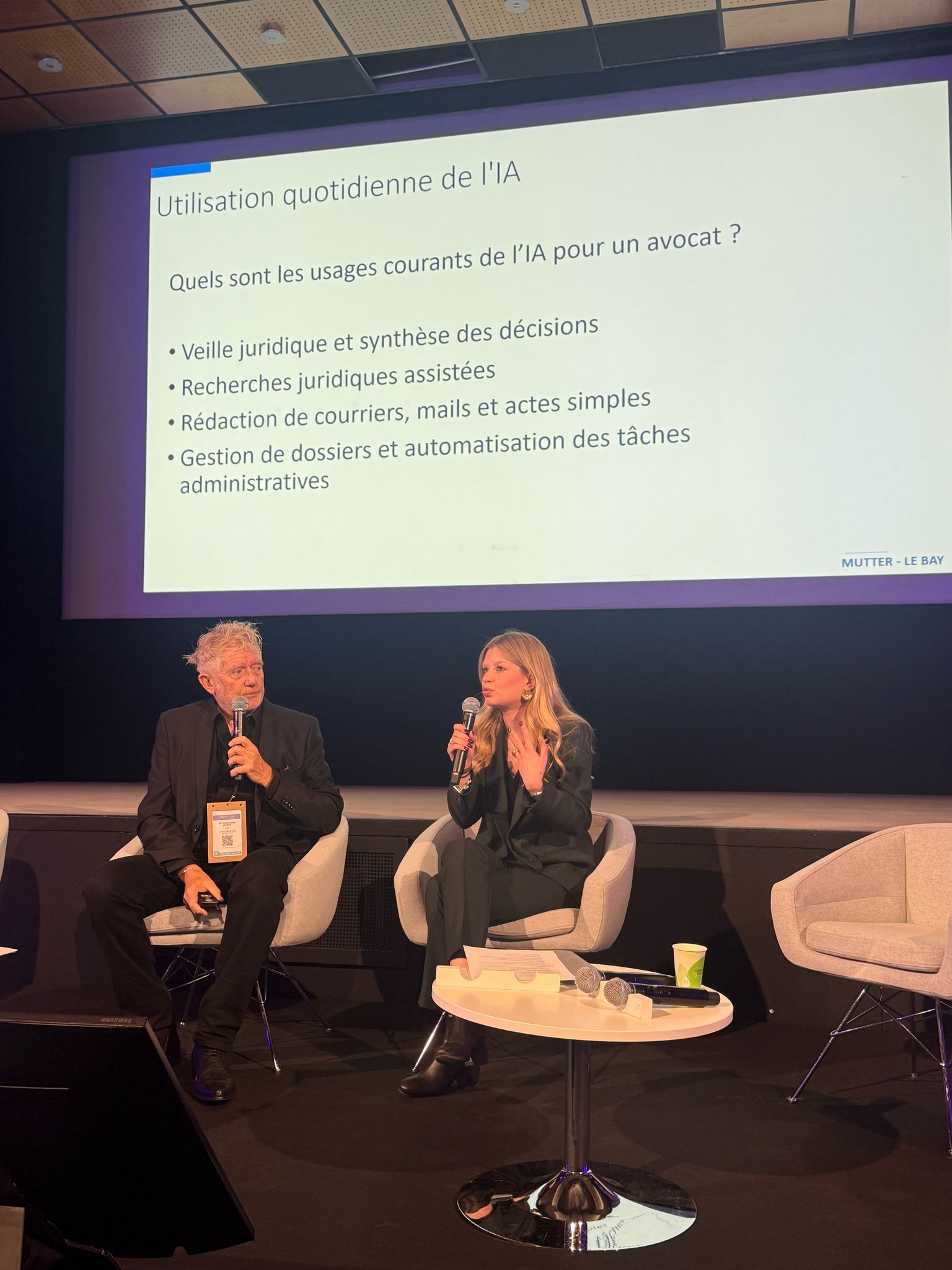

Aude Mutter, avocate au barreau de Nice, et Yves-Marie Le Bay, docteur en IA et professeur à l’Université Côte d’Azur et à l’EDHEC Business School, ont animé une conférence passionnante sur l’impact croissant de l’IA dans la profession juridique. Leur intervention a abordé trois axes majeurs : l’intégration progressive de l’IA dans les pratiques juridiques, les défis éthiques qu’elle soulève, et l’évolution du rôle des avocats face à cette transformation technologique.

Aude Mutter, avocate au barreau de Nice, et Yves-Marie Le Bay, docteur en IA et professeur à l’Université Côte d’Azur et à l’EDHEC Business School, ont animé une conférence passionnante sur l’impact croissant de l’IA dans la profession juridique. Leur intervention a abordé trois axes majeurs : l’intégration progressive de l’IA dans les pratiques juridiques, les défis éthiques qu’elle soulève, et l’évolution du rôle des avocats face à cette transformation technologique.

Loin d’être une simple révolution technique, l’IA pose des questions fondamentales sur la pratique du droit, la responsabilité des avocats, et la garantie du secret professionnel.

L’IA dans le droit : adoption et résistances

L’IA n’est plus une nouveauté dans le secteur juridique. Selon une étude Wolters Kluwerde 2024, 75 % des juristes et 68 % des avocats utilisent déjà l’IA générative au moins une fois par semaine. Toutefois, son adoption reste progressive, en raison des défis techniques et des réticences des professionnels.

Les usages concrets de l’IA dans les cabinets d’avocats

Les professionnels du droit intègrent progressivement l’IA dans leurs pratiques, notamment pour :

- La veille juridique : mise à jour automatique des réglementations et des jurisprudences, évitant aux avocats un travail fastidieux de recherche.

- La rédaction de documents : production de contrats, courriers, actes juridiques, avec une première ébauche automatisée.

- L’automatisation des tâches administratives : gestion des emails, organisation des rendez-vous, ou encore facturation.

- L’aide à la préparation des dossiers : synthèse de jurisprudences, repérage des précédents pertinents et analyse de fichiers volumineux.

Ces outils permettent un gain de temps considérable, notamment pour les tâches à faible valeur ajoutée. Un avocat peut ainsi se consacrer davantage à l’analyse stratégique des dossiers et à la relation avec ses clients.

Pourquoi une adoption encore limitée ?

Malgré ces avantages, seulement 18 % des avocats déclarent a voir recours à l’IA dans l’exercice quotidien du droit. Plusieurs freins expliquent cette prudence :

- La méfiance envers la fiabilité des outils : l’IA générative, bien que performante, peut produire des erreurs ou des « hallucinations » juridiques (références à des articles de loi inexistants).

- Les enjeux éthiques et de confidentialité : la protection des données des clients est un impératif pour les avocats, qui doivent s’assurer que les solutions utilisées respectent le secret professionnel.

- Le coût des outils : les logiciels juridiques intégrant l’IA, comme Doctrine, Rodali, GenAI-L de Dalloz, JP Intelligence Lexbase, LexisNexis, représentent un investissement conséquent pour les cabinets, avec des abonnements annuels de plusieurs milliers d’euros. Ces couts sont parfois mutualisés en fonction des barreaux. Chatgpt par exemple étant entrainé sur le droit Américain, les logiciels spécialisés dans le droit Francais sont incontournables.

Entre IA générative et IA prédictive : quelle utilisation dans le droit ?

Différencier IA générative et IA prédictive

L’IA appliquée au droit peut être générative ou prédictive :

- L’IA générative (ex. ChatGPT, Mistral, Gemini) produit du texte en se basant sur des modèles statistiques du langage. Elle est utilisée pour la rédaction de documents, la synthèse de textes ou encore l’aide à la communication.

- L’IA prédictive, quant à elle, repose sur l’analyse de données passées pour anticiper des tendances futures. Par exemple, elle peut être utilisée pour prédire l’issue probable d’un procès, sur la base de décisions judiciaires antérieures.

Vers une justice prédictive ?

L’IA prédictive soulève de nombreuses questions sur l’évolution du système judiciaire. Dans certains pays anglo-saxons, elle est déjà utilisée pour :

- Évaluer le risque de récidive d’un condamné (ex. l’outil Open-Door Assessment System en Angleterre).

- Aider les magistrats à statuer sur des affaires en s’appuyant sur des tendances statistiques.

En France, l’utilisation de la justice prédictive reste encore marginale. Toutefois, son développement pourrait avoir des implications majeures sur la profession. Si l’IA devient capable d’évaluer avec précision les chances de succès d’un procès, les modes alternatifs de règlement des conflits (médiation, arbitrage) pourraient se renforcer. Certains redoutent une déshumanisation de la justice, où les décisions seraient dictées par des algorithmes plutôt que par des juges. Mais pour les avocats, ces outils pourraient aussi permettre de mieux conseiller leurs clients en estimant les risques de chaque action en justice.

Les enjeux éthiques et juridiques de l’IA en droit

L’utilisation de l’IA par les avocats ne peut se faire sans encadrement. Plusieurs questions majeures se posent :

La responsabilité des avocats face aux erreurs de l’IA

Si un avocat s’appuie sur une IA pour rédiger un acte et que celui-ci contient une erreur juridique, qui est responsable ? Le professionnel qui l’a utilisé, l’éditeur du logiciel ou l’algorithme lui-même ? Actuellement, la responsabilité incombe toujours à l’avocat. Il doit donc vérifier et valider chaque information fournie par l’IA. Cette obligation de diligence est d’autant plus essentielle que les hallucinations de l’IA sont une réalité. Un cas célèbre aux États-Unis a vu un avocat présenter à la cour des références juridiques fictives générées par ChatGPT, entraînant des sanctions disciplinaires.

Le respect du secret professionnel

Le secret professionnel est un pilier fondamental du métier d’avocat. Or, l’utilisation de solutions comme ChatGPT pose un problème majeur : où vont les données traitées par l’IA ? Par défaut, les requêtes envoyées sur ChatGPT sont enregistrées sur des serveurs américains. Cela pose un risque de fuite d’informations sensibles et de non-conformité avec le RGPD.

Pour pallier ce problème, certaines IA, comme Mistral, offrent des solutions hébergées en Europe. Par ailleurs, des accords sont en cours pour garantir que les données des cabinets européens restent protégées lorsqu’ils utilisent des outils développés par des entreprises américaines.

L’encadrement juridique de l’IA dans le droit

La profession d’avocat est réglementée pour éviter l’exercice illégal du droit. Or, des chatbots juridiques commencent à apparaître aux États-Unis, capables de fournir des conseils automatisés. Cela pose une question cruciale : peut-on laisser une IA délivrer un conseil juridique à un particulier sans intervention humaine ? En France, seuls les avocats peuvent exercer le conseil juridique. Toute solution automatisée devra donc respecter cette règle, sous peine de sanctions pour exercice illégal de la profession.

L’avenir du droit à l’ère de l’IA : vers un avocat augmenté ?

Face à ces transformations, le métier d’avocat ne va pas disparaître, mais évoluer profondément.

- L’avocat augmenté : un professionnel assisté par l’IA : elle ne remplacera pas les avocats, mais elle permettra aux plus innovants d’optimiser leur travail. Ceux qui adopteront ces outils disposeront d’un avantage concurrentiel certain, notamment en termes de rapidité et d’efficacité.

- Un métier de plus en plus spécialisé : avec l’essor de l’IA, les tâches répétitives et généralistes seront automatisées. Les avocats devront donc se spécialiser davantage pour proposer une valeur ajoutée que l’IA ne pourra pas offrir : analyse fine des dossiers, stratégie juridique, et relation humaine avec le client.

- La nécessité d’une formation continue : l’IA évoluant rapidement, les avocats devront se former en permanence pour maîtriser ces outils et en comprendre les limites. Des formations en legal tech et en éthique de l’IA deviendront essentielles pour exercer efficacement.

L’IA transforme donc en profondeur la pratique du droit. Si elle apporte des gains de productivité considérables, elle soulève aussi des défis éthiques et juridiques majeurs. Le métier d’avocat va évoluer vers un rôle d’expert augmenté, capable de s’appuyer sur l’IA pour mieux servir ses clients, tout en garantissant la rigueur et l’éthique essentielles à la profession.