L’intelligence artificielle à l’épreuve du réel : data, processus et souveraineté selon Gilles Cymbalista

L’intelligence artificielle à l’épreuve du réel : data, processus et souveraineté selon Gilles Cymbalista

Dans l’écosystème de l’intelligence artificielle appliquée à l’entreprise, où la promesse technologique précède souvent la transformation réelle, certaines trajectoires ramènent aux fondements. Gilles Cymbalista appartient à cette génération formée à une époque où la donnée ne se manipulait pas à travers des interfaces, mais se travaillait dans sa matérialité, sous contrainte de puissance et d’architecture.

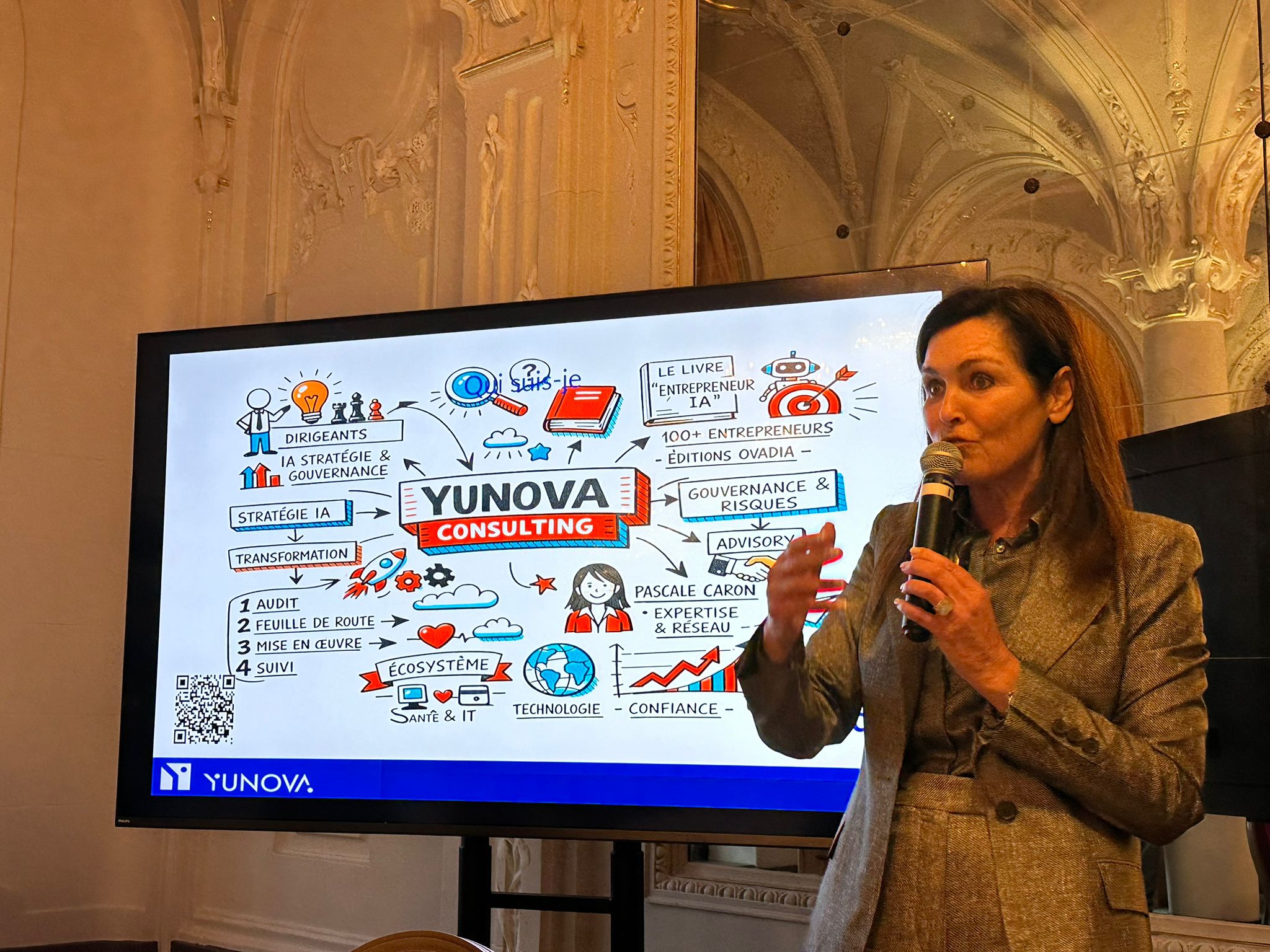

Associé et Directeur expert en data science et IA chez CGI, il vient d’un parcours d’ingénieur chercheur ancré dans le terrain. « Je suis docteur ingénieur, avec des travaux menés en recherche appliquée en entreprise. C’est là que se situe la vraie singularité de mon cursus. » Cette double expérience guide aujourd’hui sa lecture des projets d’IA.

Sa « vision réaliste de l’impact de la donnée » prend racine à La Redoute, dans un modèle où le fichier client constituait l’actif stratégique central. « Cette obsession de la qualité de la donnée, je l’ai de manière originelle. C’est la base. » À une époque où la puissance de calcul était rare, l’optimisation algorithmique relevait d’un art. Aujourd’hui, constate-t-il, l’abondance de ressources a simplifié l’usage mais éloigné de la compréhension : « on a rajouté des couches et des centrales nucléaires parce qu’on a la puissance ». Le gain en accessibilité s’est accompagné d’une perte de maîtrise.

La disparition progressive du geste scientifique

Le diagnostic est sans concession. L’industrialisation des outils de machine learning et l’automatisation des pipelines ont transformé le rapport à la donnée. « Ils prennent les données, ne les regardent même pas et les mettent dans le modèle. Ils ne regardent que le résultat. » Cette pratique produit des systèmes partiellement fonctionnels, mais elle érode la capacité d’interprétation et d’explicabilité. Or, dans des secteurs régulés comme la banque ou l’assurance, l’incapacité à expliquer une décision algorithmique est rédhibitoire. « Quand on leur pose la question : pourquoi cette variable a un impact sur l’acceptation d’un crédit ? Ils ne sont pas capables de répondre. On en perd le sens. »

La critique dépasse la nostalgie d’une génération formée aux mathématiques appliquées. Elle renvoie à un enjeu pédagogique et civilisationnel. Les abstractions logicielles ont éloigné les praticiens des lois fondamentales qui gouvernent les modèles. « Il y a des lois à respecter… une inversion de matrice qui ne se passe pas bien, le système ne le dit pas, mais il sort un résultat quand même. » Derrière la simplicité apparente des interfaces se cache une opacité technique que peu d’organisations maîtrisent réellement.

D’où l’appel à une refondation de la formation. Non pas un programme supplémentaire, mais une réflexion systémique associant enseignants, entreprises et décideurs publics pour redéfinir les savoirs fondamentaux à transmettre à l’ère de l’IA.

L’illusion de la solution technologique

Dans les grandes organisations, cette perte de maîtrise se traduit par une forme de panique. Les directions générales veulent des résultats rapides, alors même que les prérequis structurels ne sont pas réunis. « Ils croient que l’IA, c’est un modèle qu’on va venir plugger. Alors que c’est toute une transformation. » Les échecs de projets ne sont pas liés à un déficit de compétences, mais à une mauvaise évaluation de la maturité data et des transformations organisationnelles nécessaires.

La question du retour sur investissement devient centrale. « L’IA efficace, c’est cher. Il faut être sûr qu’on a un ROI. » Cette exigence explique son positionnement : ne proposer que des solutions dont l’efficacité est pré-évaluée, afin d’éviter les expérimentations coûteuses sans impact ou sens opérationnel. Le rôle du leader consiste alors à traduire des concepts complexes en trajectoires concrètes pour les métiers. « Ce n’est pas parce que c’est un DG… si tu lui expliques simplement, là tu as tout gagné. »

La donnée comme instrument de légitimation stratégique

L’expérience qu’il a menée en 2020 chez un Leader du bricolage constitue un cas d’école. L’analyse de milliers de verbatim collaborateurs pour construire la vision à long terme de l’entreprise a nécessité huit mois de structuration de la donnée, pour quatre mois d’analyse. Aujourd’hui, l’exercice serait réalisé en quelques semaines. Mais l’intérêt principal résidait ailleurs : dans la légitimation collective de la stratégie. « La restitution était fidèle… tout le monde se retrouvait dans les idées. »

La création de l’outil « Pépito », issu des pépites, destiné à détecter les idées réellement disruptives dans la masse, illustre la manière dont l’algorithmique peut révéler ce que les processus de décision humains tendent à invisibiliser. Elle met en lumière les signaux faibles portés par un individu isolé.

Former sans exclure : une autre politique de transformation

Contrairement à certaines stratégies industrielles fondées sur l’identification de collaborateurs « IA-compatibles », Gilles Cymbalista défend une approche inclusive. « On ne veut pas laisser les gens sur le bord de la route. Jamais. » L’enjeu n’est pas la substitution, mais la transformation des compétences, par des dispositifs d’apprentissage intégrés aux outils eux-mêmes. L’automatisation des tickets de support de niveau 1 par exemple, fait apparaître un angle mort organisationnel : « si les tâches de niveau 1 disparaissent, par quel parcours forme-t-on encore les experts des niveaux 2 et 3 ? » Pour Gilles Cymbalista, l’enjeu n’est pas de conserver artificiellement ces activités répétitives. Il s’agit d’intégrer la formation directement dans les systèmes d’IA, à travers des environnements de simulation et des cas fictifs. Des mécanismes d’évaluation progressive permettent ensuite de valider la montée en compétence des collaborateurs avant le passage en production. Cette logique rejoint une conviction plus large : l’acceptabilité de l’IA dépend de la manière dont elle est introduite. Ses expérimentations en centre d’appels montrent que l’adoption est immédiate lorsque les opérateurs perçoivent un bénéfice direct, notamment en termes de performance individuelle.

Souveraineté, coûts et architectures hybrides

La souveraineté n’apparaît pas ici comme un mot d’ordre politique, mais comme une équation industrielle. Elle se joue à l’échelle des investissements et des alliances. « Si on essaye de le faire en local France, on ne joue pas dans la bonne cour. Il manque trois zéros. » D’où son idée d’un consortium européen capable de porter des modèles au service des acteurs du continent. « Est-ce qu’on n’a pas intérêt à trouver un consortium entre des boîtes comme Thales, Safran… pour créer un modèle européen au profit des européens ? » La condition est claire : « il faut la volonté et le financement ».

Cette lecture s’inscrit dans une continuité historique. La domination actuelle des grandes plateformes repose d’abord sur la maîtrise des données. « Le maître du monde aujourd’hui, c’est Google par les données. » L’échec des alternatives européennes prend alors une autre signification : celle d’un moment stratégique manqué.

Pour autant, la souveraineté opérationnelle passe par des architectures hybrides. Une couche protégée pour les données sensibles, des modèles externes pour les usages génériques. « Les gros LLM non souverains sont plus puissants. Il faut vivre avec. » Le véritable enjeu devient la gouvernance des flux et la maîtrise des coûts.

Cette approche pragmatique conduit à reconsidérer l’agentique. Loin des démonstrations spectaculaires, elle ne prend sens que lorsqu’elle s’inscrit dans un processus métier clairement identifié. « Un agent sur un chatbot, ce n’est pas cohérent. Ça va impacter le temps de réponse. » En revanche, appliquée à l’optimisation des processus industriels, elle devient un levier stratégique.

Le jumeau de processus : vers une IA qui transforme sans casser

L’innovation sur laquelle il travaille actuellement illustre cette orientation. Sans tout dévoiler, elle consiste à reconstruire automatiquement un jumeau numérique des processus industriels dans une sandbox, afin de tester des scénarios d’optimisation sans modifier le système réel. Des agents spécialisés identifient les goulets d’étranglement, proposent des points d’insertion de l’IA, évaluent les gains et les coûts, puis rejouent les transformations dans le passé pour en mesurer l’impact. « Tant que l’humain n’a pas mis le tampon, ça ne sort pas de la sandbox. »

L’intérêt est double : réduire le risque de transformation et permettre une industrialisation progressive. Cette vision situe l’agentique non pas dans la génération de contenu, mais dans le passage à l’action. « Le LLM, c’est la connaissance. Le bras armé, c’est le process et l’agent. »

Décider : le dernier bastion humain

La montée en puissance des systèmes autonomes repose alors la question de la décision. Dans les domaines critiques — santé, défense, sécurité —, la séparation entre recommandation et action devient une architecture éthique. « comme dans la défense, il peut évaluer des solutions de tir, te les proposer, mais pas tirer. » Cette couche de protection constitue le véritable espace de redéfinition des métiers.

Sur le débat opposant performance humaine et performance algorithmique, son analyse est nuancée. À court terme, dans les tâches de détection ou de classification fondées sur des volumes massifs de données, la machine est structurellement avantagée. « Comme on a accès à un milliard de cas identiques, je doute que l’humain puisse lutter. » L’erreur humaine naît du doute, là où l’algorithme applique un seuil de probabilité. Mais cette supériorité technique ne signifie pas la disparition du rôle humain : elle redéfinit le périmètre de la décision et de la responsabilité.

World Model: la stratégie comme simulation

Son intérêt pour les travaux de Yann LeCun s’inscrit dans cette perspective. Le passage du « mot suivant » au « monde suivant » ouvre la possibilité d’une IA capable de simuler des trajectoires stratégiques complètes. « Donne-moi tous les scénarios pour améliorer ces lignes et le monde d’après. » Dans les grandes organisations, un tel système deviendrait un assistant de direction capable d’intégrer des milliers de signaux faibles pour proposer des transformations structurelles. Mais la maturité technologique et organisationnelle n’est pas encore atteinte.

Réapprendre à penser la transformation

Au-delà des cas d’usage, la réflexion de Gilles Cymbalista nous ramène à une question fondamentale : comment transformer sans perdre la maîtrise ? Et comment préserver les capacités cognitives nécessaires à la compréhension du monde lorsque les outils automatisent l’ensemble des opérations intermédiaires ?

Son parcours rappelle que l’IA n’est pas d’abord une technologie, mais une discipline de la donnée, de la décision et de la responsabilité.