À Sophia Antipolis, au cœur de l’écosystème azuréen de l’intelligence artificielle, la MIA accueillait un afterwork consacré à un sujet devenu central. Comment utiliser l’IA sans exposer son entreprise, ses collaborateurs, ses clients et ses données sensibles ? Derrière cette question apparemment technique se dessine un enjeu bien plus large. Celui de la gouvernance numérique et de la souveraineté. Celui de la responsabilité des organisations dans un monde où l’IA accélère autant l’innovation que la menace.

À Sophia Antipolis, au cœur de l’écosystème azuréen de l’intelligence artificielle, la MIA accueillait un afterwork consacré à un sujet devenu central. Comment utiliser l’IA sans exposer son entreprise, ses collaborateurs, ses clients et ses données sensibles ? Derrière cette question apparemment technique se dessine un enjeu bien plus large. Celui de la gouvernance numérique et de la souveraineté. Celui de la responsabilité des organisations dans un monde où l’IA accélère autant l’innovation que la menace.

La conférence, orchestrée avec le SICTIAM, la Maison de l’IA, la CCI Nice Côte d’Azur, la CASA et l’Université Côte d’Azur, réunissait deux intervenants spécialisés. Laurent Dubling, Chief Information Security Officer en temps partagé, et Laurent Baubiat, ingénieur cybersécurité et expert judiciaire. Tous deux ont livré une réflexion claire, opérationnelle et parfois volontairement inquiétante de la transformation en cours.

Leur message central tient en quelques mots : les fondamentaux de la cybersécurité restent valables, mais l’IA change l’échelle, la vitesse et la complexité des risques.

Sophia Antipolis, territoire IA et cyber

Le site Alpha, à Sophia Antipolis, est présenté comme l’un des métacampus de l’IA sur le territoire. Il réunit la Maison de l’IA, l’Eurecom IA Center, des incubateurs, une pépinière et plus de soixante start-ups. Autour de cet ensemble gravitent l’Université Côte d’Azur, 3IA Côte d’Azur, Inria, Eurecom, le campus SophiaTech, ainsi que de nombreux partenaires publics et privés.

Cette concentration d’acteurs fait de Sophia Antipolis un lieu stratégique pour penser conjointement l’IA et la cybersécurité. Car les deux domaines sont désormais indissociables. L’IA devient un outil de productivité, mais elle constitue aussi une surface d’attaque nouvelle. Elle modifie les usages internes, crée de nouveaux flux de données, introduit des fournisseurs externes et rend plus difficile la distinction entre innovation maîtrisée et expérimentation risquée.

C’est dans ce contexte qu’a été rappelée la création du Campus Cyber de Sophia Antipolis, intégré à une dynamique régionale plus large en Région Sud. À côté des campus cyber d’Euromed Marseille, de Salon-de-Provence et de Toulon, Sophia se positionne sur une verticale spécifique : IA et cyber. L’approche repose sur une gouvernance participative, la co-construction, la formation, la sensibilisation, la mobilisation d’experts et l’accompagnement des TPE, PME, collectivités et organisations publiques.

Cette dimension territoriale est importante. La cybersécurité n’est plus seulement l’affaire des grandes entreprises. Elle concerne les communes, les établissements scolaires, les associations, les professions libérales, les PME industrielles, les cabinets d’avocats, les acteurs de santé et les collectivités. Chaque organisation manipule aujourd’hui des données. Chaque organisation utilise déjà, directement ou indirectement, de l’IA. La question n’est donc plus de savoir si elle sera concernée, mais comment elle se préparera.

La fuite ANTS : un cas d’école sur la valeur des données

La conférence s’est ouverte sur un cas concret : la fuite de données touchant l’ANTS, présentée comme un incident majeur ayant concerné 11,7 millions de comptes. Les données exposées incluaient des noms, prénoms, adresses électroniques et dates de naissance. Les données biométriques et les pièces jointes n’auraient pas été divulguées, mais le préjudice demeure considérable.

Ce cas illustre une réalité essentielle : une fuite de données ne se limite pas au vol d’un fichier. Elle alimente un écosystème d’usurpation d’identité, de phishing, de fraude documentaire et de reconstitution de profils. Une adresse mail associée à un nom, un prénom et une date de naissance peut suffire à produire un message frauduleux très crédible. Croisée avec d’autres bases compromises, elle devient une matière première pour des attaques plus ciblées.

Les intervenants ont insisté sur un point : l’enjeu n’est pas seulement d’éviter l’attaque. Il est aussi de savoir combien de temps il faudra pour détecter, communiquer, contenir et reprendre l’activité. Dans le cas évoqué, plusieurs jours se sont écoulés entre la détection et la communication officielle. Ce délai interroge les processus internes de gestion de crise, mais aussi la maturité des organisations en matière de continuité d’activité.

La cybersécurité moderne doit dorénavant intégrer la détection, la réponse à incident, la traçabilité, l’information des parties prenantes, la remédiation et le retour d’expérience. Le véritable indicateur de maturité n’est plus seulement l’absence d’incident. C’est la capacité à fonctionner malgré l’incident.

L’IA transforme le paysage de la menace

En 1996, les menaces internet étaient encore marquées par les virus classiques et les chevaux de Troie. En 2006, le cybercrime organisé prend son essor avec le phishing, le vol d’identifiants bancaires et les premières grandes campagnes d’escroquerie numérique. En 2016, la professionnalisation est totale avec l’ère des ransomwares, des fuites massives et des attaques étatiques ou paraétatiques.

En 2026, selon la projection présentée, les menaces sont pilotées ou amplifiées par l’IA : phishing automatisé, deepfakes vocaux, usurpation d’identité biométrique, compromission d’objets connectés, attaques adaptatives. Le changement majeur vient de l’accélération. Une campagne de phishing crédible qui demandait autrefois plusieurs heures peut désormais être produite en quelques minutes. Un faux site peut être cloné, publié, promu et remplacé presque immédiatement après suppression.

Cette rapidité modifie la défense. Lorsqu’une entreprise fait fermer un domaine frauduleux, un autre peut apparaître dix minutes plus tard. Lorsqu’un message de phishing est détecté, une variante personnalisée peut être générée instantanément. L’attaque devient plus fluide, plus industrialisée, plus adaptative. Elle n’est plus seulement automatisée ; elle devient contextuelle.

Les ransomwares eux-mêmes s’adaptent. Les attaquants évaluent l’intérêt des données, la capacité de défense, la possibilité d’exfiltrer ou de chiffrer, puis choisissent leur stratégie. L’IA peut faciliter cette analyse préalable. Elle peut résumer des documents internes volés, identifier les données les plus sensibles, préparer des messages de pression ou automatiser des négociations.

Cette évolution oblige les entreprises à changer de posture. Il ne suffit plus de protéger un système. Il faut comprendre la donnée, connaître les flux, limiter les accès, segmenter les droits et anticiper les usages détournés.

Shadow IA: le nouveau risque majeur des organisations

Le cœur de la conférence portait sur le Shadow IA. Le terme désigne l’usage d’outils d’intelligence artificielle non autorisés ou non maîtrisés par les collaborateurs d’une organisation. Ce phénomène prolonge le Shadow IT, mais avec une gravité nouvelle. Dans le Shadow IT, un salarié pouvait utiliser un outil non validé. Dans le Shadow IA, il peut transférer des données sensibles à un modèle externe, demander une analyse juridique, résumer un dossier RH, corriger un contrat, générer du code ou traiter un fichier client.

Le risque est donc immédiat. Il touche à la confidentialité, au secret des affaires, à la propriété intellectuelle, à la conformité RGPD, à la sécurité contractuelle et à la qualité des décisions. Les intervenants ont rappelé que de nombreux salariés utilisent déjà des IA génératives grand public dans leur activité professionnelle. Certains disposent d’abonnements personnels payants. Mais une version payante ne signifie pas nécessairement une sécurité adaptée à l’entreprise. La question essentielle reste contractuelle et technique : les données sont-elles réutilisées pour entraîner le modèle ? Où sont-elles hébergées ? Qui peut y accéder ? Quels journaux sont conservés ? Existe-t-il un engagement de non-réutilisation ? Le fournisseur offre-t-il des garanties d’audit, de chiffrement, de cloisonnement et de suppression ?

Le premier risque est la fuite de données sensibles. Le second est la production de décisions faussées ou non maîtrisées. L’exemple cité de Deloitte en Australie illustre le problème : un rapport généré avec l’appui de l’IA, insuffisamment relu, peut contenir erreurs, références fictives ou approximations. Dans un contexte professionnel, ces erreurs ne sont pas anecdotiques. Elles engagent la crédibilité de l’organisation.

Le Shadow IA crée donc un paradoxe. Les collaborateurs l’utilisent souvent pour bien faire : gagner du temps, améliorer une synthèse, accélérer une recherche, automatiser une tâche. Mais en l’absence de cadre, cette initiative peut devenir une vulnérabilité majeure.

Une grille de lecture essentielle : gratuit, payant, « enterprise »

La conférence a permis d’éclairer un point souvent mal compris : tous les usages d’IA ne présentent pas le même niveau de risque, mais le prix ne constitue pas un indicateur suffisant de sécurité.

Dans la version gratuite de ChatGPT par exemple, l’utilisateur évolue dans un cadre grand public. Les données saisies peuvent être utilisées pour améliorer les modèles. Il n’existe pas de garantie forte adaptée à un usage professionnel. Le risque de fuite et de perte de contrôle est élevé. « Quand c’est gratuit, c’est vous le produit »

La version payante individuelle elle, introduit un biais cognitif. Elle améliore les performances, mais ne transforme pas fondamentalement le cadre contractuel. L’utilisateur peut avoir le sentiment d’utiliser un outil sécurisé, alors que les garanties restent limitées. Ce faux sentiment de sécurité peut conduire à des usages plus risqués.

La version « enterprise » marque une rupture. Elle propose un cadre contractuel adapté, avec des engagements sur la non-utilisation des données pour l’entraînement, des mécanismes de sécurité renforcés et une gouvernance centralisée. L’entreprise peut contrôler les accès, superviser les usages et intégrer l’outil dans son système d’information.

Mais cette solution n’est pas une réponse absolue. Elle nécessite une configuration rigoureuse, une politique claire et une formation des utilisateurs. Sans cela, les risques persistent.

Le prompt comme premier acte de gouvernance

La conférence a consacré une partie opérationnelle aux bonnes pratiques de prompt. La méthode proposée repose sur cinq questions : qui, quoi, où, comment, pourquoi. Cette approche simple permet de structurer la demande adressée à l’IA.

Le « qui » définit le rôle attendu de l’IA : expert juridique, assistant de recherche, consultant en cybersécurité, analyste documentaire. Le « quoi » précise la tâche à accomplir : résumer, comparer, extraire, reformuler, classifier, générer. Le « où » donne le contexte et l’audience cible : comité de direction, étudiants, clients, collaborateurs, décideurs publics. Le « comment » précise le style, le format, le registre de langue et le niveau de détail. Le « pourquoi » clarifie l’intention finale : préparer une décision, former, publier, auditer, convaincre ou documenter.

Cette méthode ne règle pas tout, mais elle réduit les réponses vagues, les hallucinations et les interprétations erronées. Un prompt imprécis produit une réponse aléatoire. Un prompt contextualisé améliore la pertinence du résultat.

Mais cette pratique pose immédiatement une difficulté : pour obtenir une réponse pertinente, l’utilisateur est tenté de fournir davantage de contexte. Or ce contexte peut contenir des informations sensibles. Le bon prompt n’est donc pas seulement un enjeu de performance. C’est aussi un enjeu de sécurité. Il faut apprendre à contextualiser sans divulguer.

Anonymisation, pseudo-anonymisation et minimisation

Les intervenants ont proposé des pratiques concrètes pour limiter les risques avant d’utiliser une IA. La première est la minimisation. Ne transmettre que ce qui est nécessaire. La seconde est l’anonymisation ou la pseudo-anonymisation. Avant de déposer un document dans un outil d’IA, il convient de supprimer ou transformer les noms, adresses, emails, dates de naissance, salaires, IBAN, références contractuelles, données médicales ou éléments d’identification.

Les outils les plus simples existent déjà : rechercher-remplacer dans Word ou LibreOffice, formules de transformation dans Excel ou Calc, masquage partiel, substitution aléatoire, remplacement des emails réels par des emails fictifs. Ces méthodes peuvent paraître artisanales, mais elles sont une première barrière.

Pour les fichiers PDF ou les volumes plus importants, des scripts Python peuvent automatiser certains remplacements. Mais les intervenants ont été clairs : l’anonymisation robuste est complexe. Elle devient difficile lorsque les documents contiennent des images, des scans, des tableaux, des métadonnées, des annexes ou des références croisées. Dans ce cas, des outils de data masking plus avancés sont nécessaires.

Une question posée dans la salle a permis de préciser un point essentiel : utiliser un outil d’anonymisation en ligne peut lui-même créer une fuite. Si l’on téléverse un document sensible dans un service externe pour l’anonymiser, on prend déjà le risque de transmettre l’information. Les solutions les plus sûres sont donc locales, installées sur le poste ou dans l’environnement maîtrisé de l’entreprise. La logique est simple : on ne protège pas une donnée sensible en la confiant à un outil non maîtrisé.

La donnée : partie émergée, partie immergée, partie illicite

Avant de parler d’IA, il faut parler de données. La conférence a utilisé l’image de l’iceberg pour distinguer trois catégories.

La première regroupe les données volontaires, délibérément produites et partagées : informations sur LinkedIn, annuaires professionnels, sites d’entreprise, documents publics, prompts, publications. Ces données semblent maîtrisées, mais elles peuvent être exploitées par des tiers, croisées, indexées ou réutilisées.

La deuxième catégorie concerne les données inconscientes ou involontaires : traces numériques, comportements, métadonnées, usages, historiques, informations laissées aux grandes plateformes. Cette couche est plus difficile à percevoir. Elle constitue pourtant une matière précieuse pour les modèles économiques fondés sur l’exploitation des données.

La troisième catégorie regroupe les données collectées de façon illicite, notamment lors de fuites ou de piratages. Une fois exposées, elles peuvent circuler sur le dark web, être revendues, corrélées, enrichies, puis utilisées dans des attaques ciblées.

Cette typologie rappelle une évidence souvent oubliée : la sécurité de l’IA commence avant l’IA. Elle commence par l’inventaire, la classification, la qualité, le nettoyage et la documentation des données.

Les intervenants ont donné un exemple particulièrement concret : les dossiers RH. Beaucoup d’organisations conservent des copies de permis de conduire, cartes d’identité, RIB, casiers judiciaires ou documents personnels au-delà de ce qui est nécessaire. Ces fichiers sont parfois stockés dans des répertoires partagés, sans politique claire de conservation. Lorsqu’une IA est ensuite connectée à ces données, le risque change d’échelle. Le problème n’est plus seulement le stockage excessif. C’est la capacité d’un système à traiter, résumer, extraire et réutiliser ces informations.

La gouvernance de la donnée devient donc une condition préalable à toute stratégie IA sérieuse.

Gouverner l’IA : de la sensibilisation à la politique interne

Pour les entreprises, plusieurs niveaux d’action ont été proposés.

Le premier est la visibilité. Il faut savoir quels outils IA sont utilisés, par qui, pour quoi, avec quelles données. Cela suppose d’analyser les flux, les journaux, les usages réseau, mais aussi d’instaurer un dialogue avec les équipes. Le Shadow IA prospère souvent dans le silence organisationnel.

Le deuxième niveau est la veille. Les solutions IA évoluent rapidement. De nouveaux outils apparaissent chaque semaine. Une entreprise ne peut pas tout interdire sans perdre en agilité, mais elle ne peut pas tout autoriser sans perdre le contrôle.

Le troisième niveau est la validation. Il faut identifier les solutions approuvées, examiner leurs conditions générales, contractualiser lorsque nécessaire, définir les cas d’usage autorisés et préciser les données interdites.

Le quatrième niveau est la formation. Les collaborateurs doivent comprendre ce qu’ils peuvent faire, ce qu’ils ne doivent pas faire, et pourquoi. Une charte IA trop abstraite ne suffit pas. Il faut des exemples concrets : ne pas déposer de fichier RH dans une IA grand public ; ne pas intégrer de brevet en cours ; ne pas transmettre de données client non anonymisées ; ne pas déployer du code généré sans revue humaine.

Le cinquième niveau est la gouvernance. L’entreprise doit formaliser une politique IA. Celle-ci peut être intégrée à la charte informatique ou faire l’objet d’un document spécifique. Elle doit préciser les outils autorisés, les responsabilités, les règles de validation, les exigences de sécurité, les modalités de contrôle, les sanctions éventuelles et les mécanismes d’amélioration.

Enfin, il faut une sécurité technique : contrôles des entrées et sorties, restrictions d’accès, filtrage, journalisation, segmentation, supervision des usages et blocage des services non autorisés lorsque cela est nécessaire.

Les agents IA : des salariés numériques à encadrer

Un point particulièrement important concerne les agents IA. Les intervenants ont proposé une image forte : un agent IA doit être considéré comme un salarié de l’entreprise. Cette comparaison est utile, car elle oblige à poser les bonnes questions.

À quelles données l’agent a-t-il accès ? Peut-il lire des emails ? Peut-il modifier des documents ? Peut-il interagir avec un CRM ? Peut-il envoyer des messages ? Peut-il déclencher des actions ? Qui valide ses décisions ? Quels journaux sont conservés ? Comment l’arrêter en cas de comportement anormal ?

Un agent IA autonome, connecté à plusieurs outils, peut devenir très puissant. Il peut aussi devenir très dangereux s’il est mal paramétré. Le principe du moindre privilège doit donc s’appliquer : ne donner à l’agent que les droits nécessaires à sa mission, rien de plus. La question des agents IA rejoint celle de la sécurité des API. Les intervenants ont rappelé que les bonnes pratiques existantes, notamment celles de l’OWASP, restent valables. L’IA ne supprime pas les fondamentaux. Elle les rend plus urgents.

ISO 42001 : rendre l’IA gouvernable

La conférence a ensuite abordé la norme ISO 42001, consacrée au système de management de l’IA. Les intervenants ont insisté sur une approche pragmatique : l’objectif n’est pas de « faire de la conformité pour la conformité ». Il s’agit de rendre l’IA plus gouvernable, plus explicable, plus fiable et plus déployable à grande échelle.

Un système de management de l’IA permet de structurer les rôles, les responsabilités, les analyses de risque, les contrôles, les usages autorisés, la documentation, le suivi et l’amélioration continue. Il s’adresse aussi bien aux organisations qui développent des systèmes d’IA qu’à celles qui les fournissent, ou les utilisent.

La norme ne remplace pas les autres cadres. Elle vient s’articuler avec l’ISO 27001 pour la sécurité de l’information, le RGPD pour les données personnelles, l’AI Act pour les obligations européennes liées aux systèmes d’IA, ainsi qu’avec d’autres référentiels sectoriels.

Les gains évoqués sont multiples : gouvernance renforcée, réduction des risques juridiques, techniques et réputationnels, préparation réglementaire, confiance des parties prenantes, efficacité opérationnelle et passage à l’échelle. Une entreprise qui déploie plusieurs projets IA ne peut pas reconstruire un cadre de gouvernance à chaque initiative. Elle doit disposer d’un socle commun.

La logique est celle de la roue de Deming : planifier, mettre en œuvre, contrôler, améliorer. Cette démarche continue est essentielle, car l’IA évolue vite. Les risques d’aujourd’hui ne sont pas nécessairement ceux de demain.

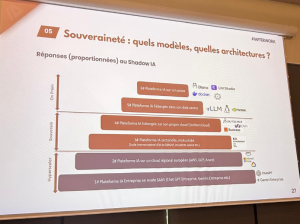

Souveraineté : choisir l’architecture adaptée au risque

La dernière partie de la conférence a porté sur les modèles d’architecture. Le propos était particulièrement utile, car il évitait les oppositions simplistes. Il ne s’agit pas de dire qu’un modèle est bon et qu’un autre est mauvais. Il s’agit de choisir une solution proportionnée au niveau de risque, au type de données, aux compétences disponibles et aux objectifs métier.

Le premier niveau correspond aux solutions IA Enterprise ou Business proposées par les grands acteurs. Elles permettent un meilleur contrôle que les comptes grand public, avec des engagements contractuels, un cloisonnement des données et une moindre réutilisation pour l’entraînement. Pour de nombreuses entreprises, c’est une première étape réaliste.

Le premier niveau correspond aux solutions IA Enterprise ou Business proposées par les grands acteurs. Elles permettent un meilleur contrôle que les comptes grand public, avec des engagements contractuels, un cloisonnement des données et une moindre réutilisation pour l’entraînement. Pour de nombreuses entreprises, c’est une première étape réaliste.

Le deuxième niveau consiste à utiliser une plateforme IA sur un cloud régional européen, avec choix du modèle, localisation plus précise et contrôle renforcé. Des services comme AWS Bedrock permettent par exemple de sélectionner des modèles, de configurer des agents et de choisir des régions d’hébergement.

Le troisième niveau concerne les plateformes sectorielles mutualisées. Elles peuvent répondre aux besoins de secteurs sensibles, comme la justice, la santé ou les administrations, avec des environnements adaptés à la confidentialité des dossiers.

Le quatrième niveau repose sur un cloud souverain ou qualifié, par exemple SecNumCloud, permettant d’héberger des modèles sur des infrastructures maîtrisées.

Le cinquième niveau correspond à l’hébergement dans son propre data center, avec serveurs, cartes graphiques, modèles choisis, outils d’inférence et contrôle interne plus fort. Cette option s’adresse plutôt aux grandes organisations ou aux secteurs très sensibles.

Enfin, le dernier niveau est local : faire tourner un modèle sur son propre poste ou sur un petit serveur, sans connexion externe, avec des outils comme GPT4All, Ollama, Docker Desktop ou LM Studio. Cette approche permet de traiter certains documents sans qu’ils quittent l’environnement de l’utilisateur. Elle exige toutefois des compétences techniques et du matériel adapté.

Cette gradation est précieuse, car elle montre que la souveraineté n’est pas un slogan. C’est une architecture, un arbitrage et un coût. Elle doit être pensée en fonction de l’usage réel.

Résilience numérique : l’exemple coréen et le réveil européen

Les intervenants ont élargi la réflexion à la souveraineté numérique. L’exemple de la Corée du Sud a été mobilisé pour montrer qu’un pays peut développer un écosystème numérique propre : moteurs de recherche, messageries, paiement mobile, cartographie, applications de mobilité, infrastructures matérielles. Cette autonomie ne signifie pas isolement. Elle signifie capacité de choix.

L’Europe, de son côté, dispose de données, de talents, de normes, d’acteurs industriels et de centres de recherche. Mais elle reste fortement dépendante de technologies, de plateformes et d’infrastructures extra-européennes. Cette dépendance devient plus sensible dans un contexte géopolitique instable.

L’exemple du juge français Nicolas Guillou, visé par des sanctions américaines dans le cadre de ses fonctions à la Cour pénale internationale, a servi à illustrer les effets concrets de ces dépendances. Lorsqu’un acteur est sanctionné par une puissance étrangère, des services numériques, financiers ou contractuels peuvent devenir indisponibles, y compris en Europe. Le sujet dépasse donc la cybersécurité. Il touche à la continuité d’activité, à l’indépendance juridique et à la capacité d’une institution à fonctionner.

Le débat sur les clouds souverains a également montré la complexité du sujet. Une infrastructure opérée en Europe, par des acteurs européens, mais reposant sur des technologies américaines, offre-t-elle une souveraineté complète ? Probablement pas. Offre-t-elle une souveraineté opérationnelle partielle ? Sans doute. Mais il faut regarder précisément les contrats, les dépendances, les mises à jour, les clés de chiffrement, les risques d’obsolescence et les obligations extraterritoriales.

La souveraineté ne se décrète pas. Elle se vérifie.

Un message final : apprendre, critiquer, maîtriser

La conférence s’est conclue sur un appel à la lucidité. L’IA n’est ni à rejeter ni à adopter aveuglément. Elle doit être comprise, testée, encadrée, documentée et gouvernée. Les organisations doivent apprendre à l’utiliser sans abandonner leur esprit critique.

Le véritable danger ne vient pas seulement de l’outil. Il vient de l’illusion de facilité. Une IA qui répond vite n’a pas nécessairement raison. Une IA qui produit un texte convaincant peut halluciner. Une IA qui code peut introduire des vulnérabilités. Une IA qui résume peut omettre un détail crucial. Une IA qui automatise peut agir au-delà de ce qui était prévu.

À l’inverse, une IA bien encadrée peut devenir un levier considérable. Elle peut aider à analyser des risques, documenter des processus, accélérer la conformité, améliorer la formation, détecter des anomalies, assister les équipes et renforcer la productivité. Mais elle ne peut produire de valeur durable que si les données sont maîtrisées, les responsabilités définies et les usages sécurisés.

L’enseignement majeur de cette conférence tient donc dans cette articulation : oser l’IA, oui ; mais pas sans gouvernance. Expérimenter, oui ; mais pas sans cadre. Automatiser, oui ; mais pas sans contrôle humain. Déployer, oui ; mais pas sans stratégie de données. Car la question n’est plus seulement : que peut faire l’IA pour l’entreprise ? La vraie question devient : que devient l’entreprise lorsque ses données, ses décisions et ses processus commencent à être traités par des systèmes qu’elle ne maîtrise pas totalement ?