Faut-il interdire l’intelligence artificielle dans l’enseignement supérieur et dans les organisations ? La question, souvent posée de manière binaire, masque un enjeu bien plus subtil. L’IA n’est pas en train de remplacer l’intelligence humaine. Elle est en train d’en déplacer les frontières. Et ce déplacement, s’il n’est pas maîtrisé, pourrait fragiliser précisément ce que les institutions cherchent à développer : la capacité à penser.

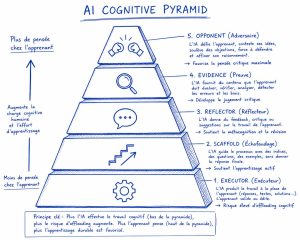

L’article The AI Cognitive Pyramid d’Inara Scott propose une lecture particulièrement structurante de cette mutation. Son apport n’est pas technologique, mais cognitif. Il ne s’agit pas d’évaluer ce que l’IA permet de faire, mais ce qu’elle transforme dans la manière même dont nous apprenons, raisonnons et décidons.

Le point de départ est une observation empirique désormais récurrente dans la littérature scientifique. L’usage de l’IA améliore les performances visibles, mais ne garantis pas et parfois dégrade l’apprentissage réel. Ce paradoxe n’est pas une anomalie. Il est le produit d’un mécanisme bien identifié : la décharge cognitive.

Notre cerveau est conçu pour optimiser l’effort. Face à un système capable de produire des réponses complètes, structurées, souvent convaincantes, nous adoptons spontanément une posture de délégation. Ce qui était autrefois un processus, analyser, structurer, argumenter, devient un produit. Et dans ce passage du processus au résultat, une partie essentielle de l’apprentissage disparaît.

Ce phénomène est amplifié par une caractéristique propre à l’IA générative : sa capacité à produire des réponses fluides, cohérentes, sans signal évident d’incertitude. Cette fluidité crée une illusion cognitive. L’utilisateur ne perçoit plus la distance entre comprendre et utiliser. Il confond la qualité du texte produit avec la profondeur de sa propre compréhension.

Les travaux cités dans l’article sont particulièrement éclairants. Dans une étude menée auprès d’étudiants en mathématiques, l’accès à GPT-4 a permis d’améliorer les résultats de près de 50 % durant la phase d’entraînement. En revanche, les performances ont chuté de manière significative lors des évaluations réalisées sans assistance. Ce résultat met en évidence une dissociation critique : la performance observable n’est pas un indicateur fiable de l’apprentissage.

Une autre étude montre que l’utilisation de ChatGPT améliore la qualité rédactionnelle des essais, mais ne produit aucun gain en termes de compréhension ou de transfert des connaissances. Plus encore, elle réduit l’engagement métacognitif, c’est-à-dire la capacité des étudiants à réfléchir sur leur propre raisonnement.

C’est dans ce contexte que la pyramide cognitive prend tout son sens. Elle ne propose pas une typologie des usages, mais une cartographie du travail mental. Chaque niveau correspond à une redistribution spécifique de quatre fonctions cognitives fondamentales : la génération (produire une idée), l’évaluation (juger sa validité), l’effort cognitif (traverser la difficulté) et l’encodage (ancrer la connaissance dans la mémoire).

Au niveau de l’Exécuteur, ces quatre fonctions sont largement externalisées. L’IA génère, structure, souvent évalue implicitement. L’utilisateur intervient à la marge. Ce mode d’usage élimine ce que les chercheurs appellent les « difficultés désirables ». Or, ces difficultés, l’effort de rappel, la confrontation à l’erreur, la construction progressive d’un raisonnement, sont précisément les mécanismes qui permettent l’apprentissage durable.

L’un des apports les plus intéressants de l’article est de montrer que cette externalisation ne se limite pas à une perte d’effort. Elle modifie la structure même des connaissances. Les auteurs cités évoquent trois types de savoir : les savoirs issus de l’expérience, les savoirs liés au contexte culturel et aux normes sociales, ainsi que les savoirs conceptuels mobilisés dans la résolution de problèmes abstraits. L’usage intensif de l’IA en mode exécuteur tend à fragiliser ces trois dimensions, en réduisant les occasions de confrontation directe au problème.

À mesure que l’on progresse dans la pyramide, la situation évolue. Le niveau du Guide introduit une forme d’équilibre. L’IA structure le raisonnement, mais ne le remplace pas. Ce rôle correspond aux systèmes de tutorat. Toutefois, l’article met en évidence une instabilité structurelle : le glissement vers le mode Exécuteur. Ce phénomène, appelé « role drift », n’est pas accidentel. Il résulte de la manière dont les modèles de langage sont entraînés : ils sont conçus pour être utiles, donc pour répondre. Face à une ambiguïté, ils la résolvent. Face à une difficulté, ils la simplifient.

Ce point est crucial. Il signifie que l’usage « intelligent » de l’IA ne repose pas uniquement sur l’utilisateur, mais sur l’architecture de l’interaction. Sans contraintes explicites, sans design pédagogique, la dérive vers la substitution cognitive est inévitable.

Le niveau du Miroir introduit une logique différente. L’effort initial est humain. L’IA intervient comme un révélateur. Cette configuration est particulièrement intéressante, car elle préserve l’effet de génération, un mécanisme bien documenté en psychologie cognitive : le fait de produire une information renforce sa mémorisation, même si elle est ensuite corrigée.

Le niveau du Miroir introduit une logique différente. L’effort initial est humain. L’IA intervient comme un révélateur. Cette configuration est particulièrement intéressante, car elle préserve l’effet de génération, un mécanisme bien documenté en psychologie cognitive : le fait de produire une information renforce sa mémorisation, même si elle est ensuite corrigée.

Mais c’est dans les niveaux supérieurs que le modèle révèle toute sa puissance. Le niveau de l’Auditeur impose une inversion radicale. L’IA produit, mais l’humain doit juger. Cette situation mobilise des processus cognitifs complexes : activation des connaissances préalables, comparaison, vérification, détection d’incohérences. Elle transforme l’utilisateur en expert critique.

Cependant, ce niveau comporte une limite importante, souvent sous-estimée. Il suppose un niveau de connaissance suffisant pour évaluer l’IA. Sans cela, l’utilisateur risque de valider des erreurs plausibles. L’article souligne que les étudiants les plus faibles sont ceux qui bénéficient le moins de l’IA, précisément parce qu’ils ne disposent pas des repères nécessaires pour juger la qualité des réponses.

Le niveau de l’Opposant pousse cette logique encore plus loin. L’IA devient un adversaire intellectuel. Elle questionne, contredit, déconstruit. Ce type d’interaction s’inscrit dans la tradition du dialogue socratique. Il force l’utilisateur à expliciter ses hypothèses, à défendre ses positions, à réviser ses arguments.

Ce mécanisme active pleinement les processus d’apprentissage autorégulé. L’individu ne se contente plus de produire une réponse. Il surveille, ajuste, corrige en continu son raisonnement. C’est précisément ce type d’engagement qui est associé aux formes d’apprentissage les plus profondes.

Mais cette montée en complexité a un coût. L’article mentionne un phénomène encore peu exploré : la fatigue cognitive liée à l’IA. Les utilisateurs qui doivent constamment évaluer et superviser les réponses de l’IA expérimentent une surcharge mentale. Cela introduit une tension nouvelle : les usages les plus cognitivement bénéfiques sont aussi les plus exigeants.

Cette tension ouvre un champ de réflexion stratégique. Dans les organisations, l’IA est souvent déployée pour optimiser la productivité. Or, les usages les plus efficaces à court terme, mode Exécuteur, sont précisément ceux qui risquent d’éroder les compétences à long terme. À l’inverse, les usages qui renforcent la pensée, mode Opposant , sont plus coûteux en temps et en effort.

Le modèle de Scott ne tranche pas cette tension. Il la rend visible. Il propose une direction : réduire progressivement la dépendance au mode Exécuteur et augmenter les situations où l’individu doit générer, évaluer, justifier.

Cette orientation implique une transformation profonde du design des apprentissages. Il ne suffit plus de donner accès à l’IA. Il faut organiser les interactions. Imposer des contraintes. Créer des moments sans assistance. Exiger des traces du raisonnement. Cela suppose également une évolution du rôle des enseignants et des managers. Ils deviennent des architectes du travail cognitif. Leur mission n’est plus seulement de transmettre un contenu, mais de structurer les conditions dans lesquelles la pensée peut se développer.

Au-delà de la pédagogie, cette réflexion interroge la nature même de l’intelligence dans un monde où les réponses sont instantanément accessibles. Si la production d’information n’est plus un avantage compétitif, alors la valeur se déplace vers la capacité à poser des questions, à évaluer des réponses, à naviguer dans l’incertitude.

L’IA ne supprime pas la nécessité de penser. Elle en modifie les règles. Et c’est précisément là que réside l’enjeu. Car si nous ne structurons pas consciemment notre relation à ces outils, nous risquons de devenir extrêmement performants… sans réellement comprendre ce que nous faisons.

Il est temps de changer de posture. De passer du mode Exécuteur au mode Opposant. Et vous, à quel niveau de la pyramide opérez-vous le plus souvent ?